ローカルLLMをMacで導入するにはどれがいいの?

今後、組織内で生成AIを使っていくにはローカルLLMを導入せざるを得ないでしょう。セキュリティの観点でも。ということで、とりあえず検証です。何を使ったらいいか聞いてみました。

ソフトウェアの選択

初心者の方には、画面操作だけで完結するLM Studioが一番おすすめです。Ollamaという選択肢もありますが、こちらはターミナル(黒い画面)を使うので、慣れていないと少しハードルが高いです。

| ツール | 操作方法 | 難易度 |

|---|---|---|

| LM Studio | マウスで操作(GUI) | やさしい ◎ |

| Ollama | ターミナル中心 | 中級 |

| MLX LM | コマンド・コード | 上級 |

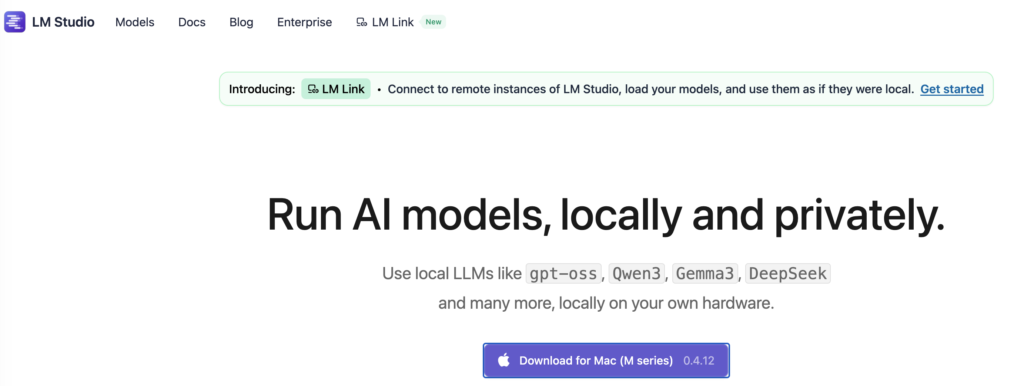

LM Studioをダウンロード・インストール

ということで、LM Studioを入れていってみます。

LMStudioのページからMac用をダウンロード。

インストールしてGetStarted

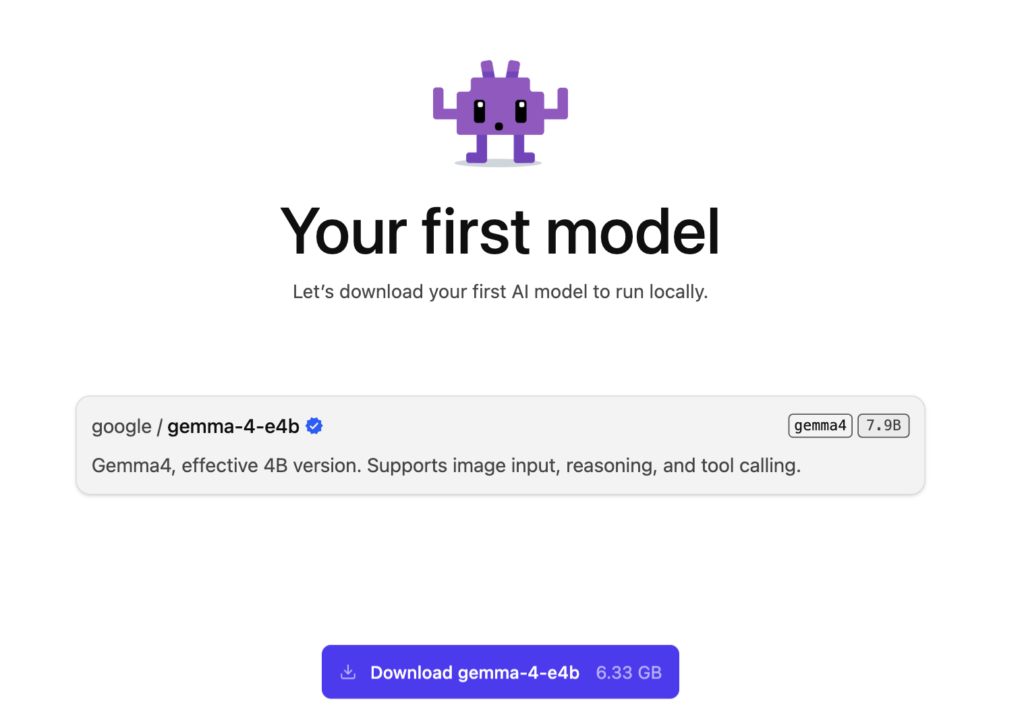

モデルを選択してすすみます。まずは gemma-4で試せばいいでしょうかね。AIもお勧めしてきましたし。

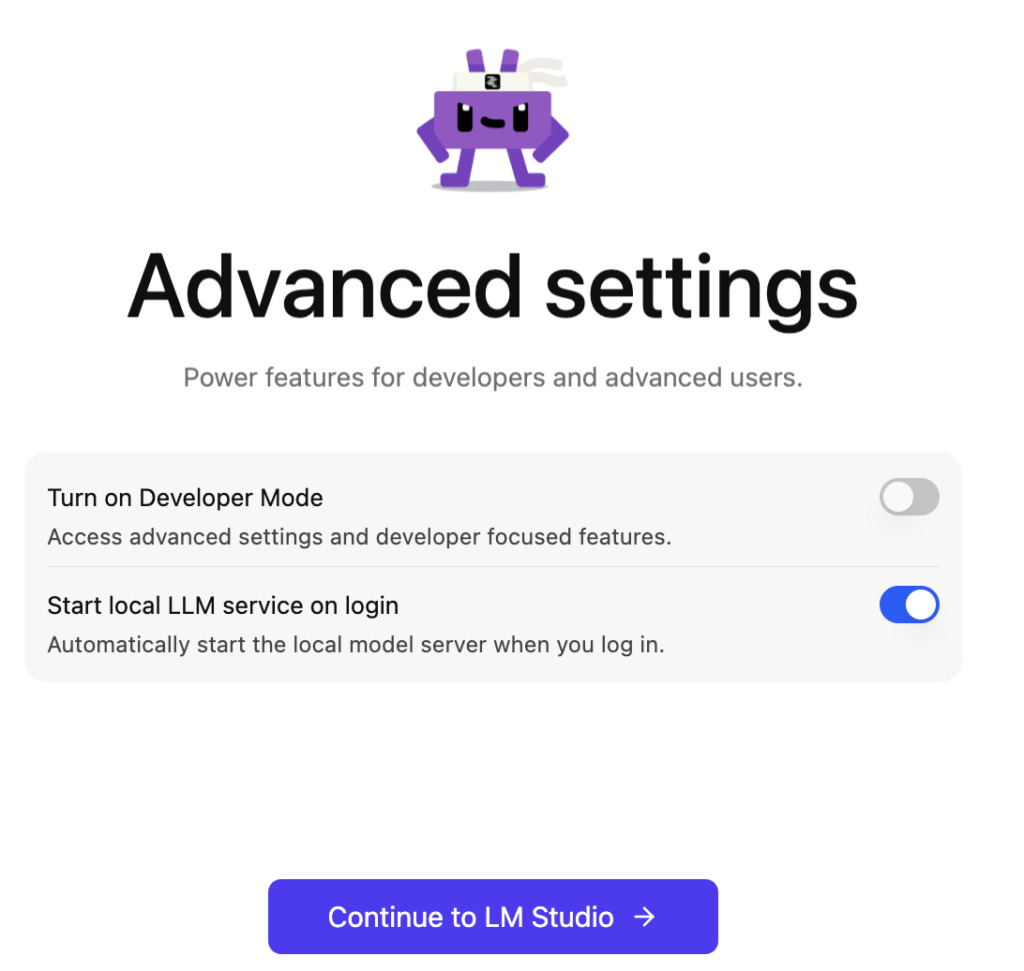

Developerモードとサービス利用モードがあるのですね。まずは利用モードで入ってみます。

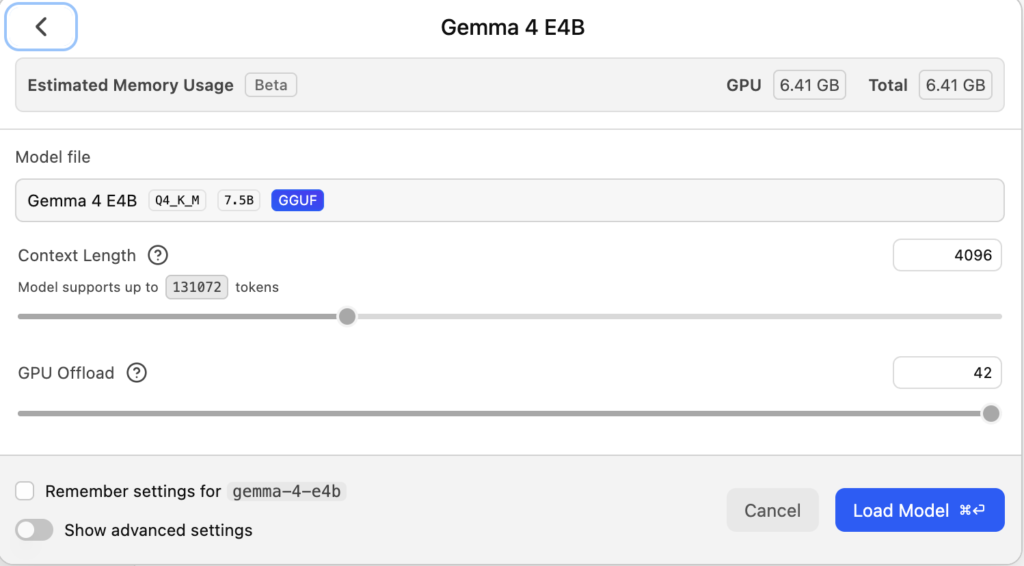

LM-Studioに入るとモデル選択して設定の画面になりました。このままでとりあえず進めてみましょうかね。

GPU Offloadとか振り切っちゃてますけど大丈夫でしょうかね。他の作業していないマシンならいいか。

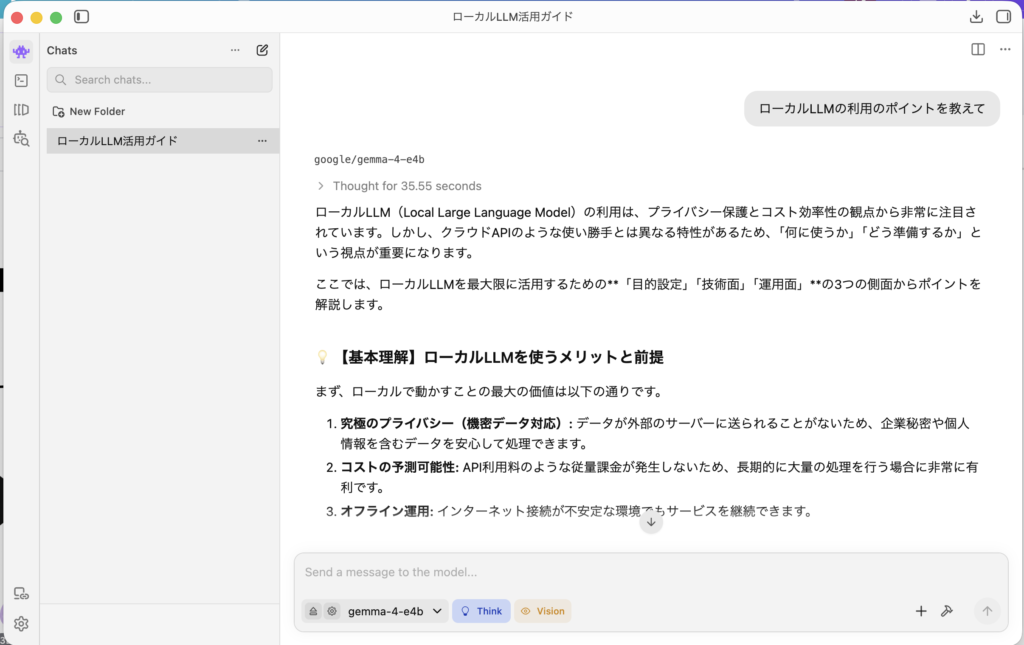

ということで、あっさり動きました。通常のチャット画面から質問してみました。

質問したら回答くれました。しかし、オンラインで使うのよりかなり回答速度はゆっくりです。まあ、今MacBookAirで動かしてみたので仕方なしですかね。

私の個人利用ではローカルで使う意味はあまりありませんが、今後のことを考えて、どのような遣い方ができるのか試していきたいと思います。

そんなところで